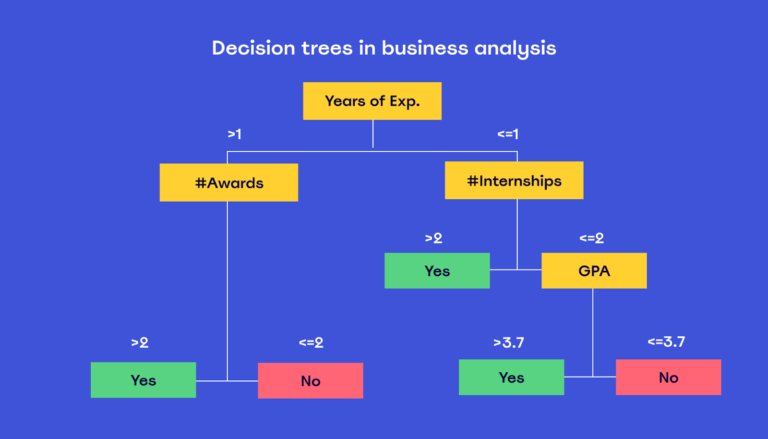

Ein decision tree ist ein überwachter maschineller Lernalgorithmus, der eine Reihe aufeinanderfolgender Entscheidungen erstellt, um ein bestimmtes Ergebnis zu erreichen.

Decision tree kombinieren mehrere Datenpunkte und wägen Unsicherheitsgrade ab, um die beste Vorgehensweise bei komplexen Entscheidungen zu ermitteln. Mit diesem Prozess können Unternehmen Produkt-Roadmaps erstellen , zwischen Lieferanten wählen, die Fluktuation reduzieren , Bereiche mit Kostensenkungspotenzial ermitteln und vieles mehr.

Wofür wird ein decision tree verwendet?

Normalerweise verwenden wir decision tree, um fundierte Meinungen zu erstellen, die eine bessere Entscheidungsfindung ermöglichen.

Decision tree ermöglichen es uns, Informationen in mehrere Variablen aufzuschlüsseln, um zu der optimalen Lösung eines Problems zu gelangen.

Um wirksam zu sein, müssen decision tree alle Möglichkeiten klar und strukturiert umrissen enthalten. Sie müssen den Datenwissenschaftlern aber auch mehrere Möglichkeiten bieten , gemeinsam Entscheidungen zu treffen und das Unternehmenswachstum zu optimieren.

Decision tree vs. Random Forest: Was ist der Unterschied?

Random-Forest-Algorithmen unterscheiden sich von decision tree durch ihre Fähigkeit, mehrere Entscheidungen zu bilden, um zu einer endgültigen Mehrheitsentscheidung zu gelangen.

Decision tree berücksichtigen mehrere Variablen, um mögliche Ergebnisse zu bestimmen, die es uns letztendlich ermöglichen, eine einzige, beste Entscheidung zu treffen. Random-Forest -Algorithmen gehen einen Schritt weiter und verlassen sich nicht auf eine einzige Entscheidung. Stattdessen stellen sie zufällige Entscheidungen auf der Grundlage mehrerer zuvor getroffener Entscheidungen zusammen und stützen so die endgültige Entscheidung auf eine Mehrheitsmeinung. Ein Random Forest besteht im Wesentlichen aus den Ergebnissen mehrerer decision trees, die gegeneinander abgewogen werden, um durch kontinuierliche Entscheidungsfindung ein einziges Ergebnis zu präsentieren. Das heißt, Random Forest bestimmt nicht unbedingt die beste Lösung, sondern führt stattdessen mehr Vielfalt ein, um eine glattere Vorhersage basierend auf dem Ergebnis mit der größten Wahrscheinlichkeit zu erstellen.

Was sind die Nachteile eines decision trees?

Die Hauptnachteile von decision trees liegen in ihrer Tendenz, schnell kompliziert und informationsintensiv zu werden.

Decision trees werden verwendet, um logische Lösungen für komplexe Probleme zu finden. Sie sind jedoch ineffektiv, wenn sie nicht alle möglichen Ergebnisse einer möglichen Entscheidung enthalten. decision trees neigen daher dazu, mit mehreren Zweigen überladen zu werden, die viele Variablen enthalten und sich oft in völlig separate Ergebnisse verzweigen. Dies kann zu einer überwältigenden Datenmenge und mehr Verwirrung als Klarheit bei der Entscheidungsfindung führen Shapiro-Wilk Test.

Decision trees können auch zu Problemen führen, wenn qualitative Variablen verwendet werden, also solche, die keinen numerischen Wert haben, sondern in Kategorien passen, um Entscheidungen zu treffen. Qualitativen Variablen können für die Datenanalyse Zahlen zugewiesen werden, aber qualitative Daten können dennoch eine erstaunliche Anzahl von Verzweigungen erzeugen oder völlig unklare Entscheidungsmöglichkeiten bieten.